2026/4/18 10:50:27

网站建设

项目流程

技术支持:洛阳网站建设,浏览器网址链接,仿木鱼网络网站,微信公众号做网站卖东西GitHub Wiki 搭建 PyTorch 项目文档#xff1a;知识沉淀好帮手

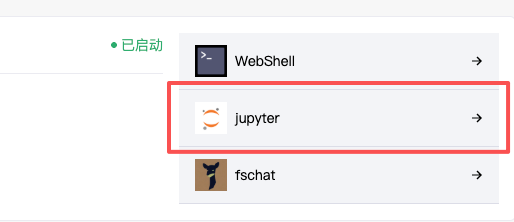

在深度学习项目开发中#xff0c;你是否经历过这样的场景#xff1f;新同事花了三天才把环境配通#xff0c;跑通第一个 demo 的时候欢呼雀跃#xff1b;线上模型突然报错 CUDA out of memory#xff0c;翻遍…GitHub Wiki 搭建 PyTorch 项目文档知识沉淀好帮手在深度学习项目开发中你是否经历过这样的场景新同事花了三天才把环境配通跑通第一个 demo 的时候欢呼雀跃线上模型突然报错CUDA out of memory翻遍聊天记录才发现三个月前有人提过类似问题但没留文档你想复现一篇论文的实验结果却记不清当时用的是 PyTorch 1.13 还是 2.0 —— 更别提对应的 CUDA 版本了。这些问题的本质不是技术难题而是知识管理的缺失。代码可以版本化环境却常常“只存在于某个人的电脑里”。而真正的工程化能力往往体现在能否让一个项目在人员流动、时间推移后依然可维护、可扩展。幸运的是我们有解法用容器固化环境用 Wiki 沉淀知识。将 PyTorch-CUDA 镜像与 GitHub Wiki 结合不仅能解决“在我机器上能跑”的经典困境更能构建一套可持续演进的知识体系。想象一下这种工作流新人入职第一天打开项目仓库点击 Wiki看到一张清晰的架构图和三步启动指南。他复制一条命令五分钟后就在浏览器里跑通了训练脚本。遇到参数不懂点开《超参配置说明》页面不仅有字段解释还有历史实验对比图表。中途发现文档有个笔误直接 fork wiki 仓库改完提交 PR —— 就像贡献代码一样自然。这并不是理想化的设想而是完全可以通过现有工具实现的现实方案。核心就在于两个看似简单、实则强大的组件PyTorch-CUDA 容器镜像和GitHub Wiki。先说镜像。所谓pytorch-cuda:v2.8本质上是一个“打包好的操作系统”里面已经装好了你做深度学习所需的一切NVIDIA 驱动接口、CUDA 11.8或 12.1、cuDNN 加速库、PyTorch 2.8 官方二进制包甚至预装了 Jupyter 和 SSH 服务。它不依赖你的本地 Python 版本也不关心你有没有手动装过 torchvision。只要宿主机有 NVIDIA 显卡驱动和 Docker 环境就能一键拉起完全一致的运行时。它的分层设计非常巧妙。底层是轻量 Ubuntu 基础镜像往上叠加 CUDA 工具链再安装 Conda 或 Pip 管理的 Python 生态最后注入项目专属依赖。每一层都可缓存更新时只需重建变动部分。更重要的是通过 NVIDIA Container Toolkit容器内的torch.cuda.is_available()能真实感知到物理 GPU意味着你在里面写的分布式训练代码和在裸机上跑的行为完全一致。实际使用时一条命令即可启动docker run -it --gpus all \ -p 8888:8888 \ -p 2222:22 \ -v $(pwd)/notebooks:/workspace/notebooks \ pytorch-cuda:v2.8这里--gpus all是关键它告诉 Docker 启用 GPU 设备映射端口映射让你能从浏览器访问 Jupyter挂载目录则确保数据和代码持久化。整个过程不到五分钟且所有团队成员运行的是同一个字节都不差的环境镜像。但这只是第一步。环境统一了如果没人知道怎么用依然低效。这时候就需要 GitHub Wiki 登场。很多人误以为 Wiki 只是“多个 README”其实不然。它是独立于主代码库的 Git 仓库[repo].wiki.git支持完整的版本控制、分支协作和权限管理。你可以把它看作项目的“官方说明书中心”—— 不是用来写临时笔记的地方而是承载结构化知识的载体。比如一个典型的 AI 项目 Wiki 应该长这样Home.md ├── 快速入门指南.md ├── 环境搭建全流程.md ├── 数据预处理规范.md ├── 模型训练 SOP.md ├── 推理 API 接口文档.md ├── 性能测试报告.md └── 常见问题与排错手册.md每个页面都不是孤立存在。首页用卡片式导航引导用户子页面之间通过[训练流程](模型训练-SOP)这样的内部链接串联成网。你可以在《排错手册》里引用《环境变量说明》也可以在《性能报告》中嵌入训练曲线图。所有内容用 Markdown 编写工程师无需学习新语法就能参与编辑。更重要的是这套系统天然适合自动化集成。比如配合 CI/CD 流程在每次训练结束后自动更新“最新准确率”字段或者当镜像发布新版本时触发 webhook 修改《环境搭建》页中的拉取命令。文档不再是静态快照而成了动态反映项目状态的“活文档”。实际操作也很简单。克隆 wiki 仓库后初始化首页可以这样写# 项目文档中心 欢迎使用本项目的官方 Wiki ## 快速入口 - [环境搭建](环境搭建全流程) - [训练流程](模型训练-SOP) - [API 接口](推理-API-接口文档)然后为关键流程配上图文教程。例如在环境搭建页插入截图展示 Jupyter 登录界面并附上可复制的 SSH 命令块## 启动方式一Jupyter Notebook  访问地址http://host:8888输入 token 登录。 ## 启动方式二SSH 连接 使用命令ssh root -p 2222密码your_password这些看似基础的操作恰恰是降低认知负荷的关键。新手不再需要到处问“怎么连服务器”老成员也不必反复回答相同问题。知识一旦沉淀就具备了复利效应。从系统架构上看这三者形成了清晰的层级关系--------------------- | GitHub Wiki | ← 知识载体如何做 -------------------- | v --------------------- | PyTorch-CUDA-v2.8 | ← 执行环境在哪做 -------------------- | v --------------------- | NVIDIA GPU (宿主机) | ← 算力基础靠什么做 ---------------------Wiki 告诉你“做什么”和“怎么做”镜像提供“在哪里做”的标准化沙箱GPU 则支撑“靠什么做”的计算需求。三层解耦各司其职。在这种模式下典型的工作流变得极为顺畅。新成员加入 → 查阅 Wiki 获取指引 → 执行 docker run 命令 → 通过 Jupyter 或 SSH 进入容器 → 参考文档完成开发任务 → 发现文档不足时反向贡献修正。整个过程形成闭环而且每一步都有迹可循。当然要真正发挥这套体系的价值还需要一些工程上的精细打磨。首先是版本控制意识。镜像必须打标签建议采用语义化命名如pytorch-cuda:v2.8-cuda11.8-ubuntu20.04避免使用latest这种模糊标签。一旦某个版本被项目正式采用就应冻结不再修改后续更新另起新标签。否则今天还能跑的实验明天docker pull一下就崩了那反而增加了不确定性。其次是文档组织逻辑。不要把 Wiki 当垃圾桶什么都往里塞。推荐采用“自顶向下”的信息架构首页作为总览第二层按功能模块划分如训练、推理、部署第三层才是具体操作指南。每篇文章聚焦单一主题保持短小精悍。对于复杂流程可用 Mermaid 绘制流程图辅助说明graph TD A[克隆代码库] -- B[查阅 Wiki 入门指南] B -- C[拉取 pytorch-cuda:v2.8 镜像] C -- D{选择交互方式} D -- E[Jupyter Notebook] D -- F[SSH 终端] E -- G[编写训练脚本] F -- G G -- H[参考超参配置表] H -- I[启动训练任务] I -- J[查看日志与指标]安全性也不能忽视。虽然方便但默认开启 Jupyter 和 SSH 仍存在风险。生产环境中应通过环境变量传入密码而非硬编码在镜像中对外暴露的服务需加认证层定期用 Trivy 等工具扫描镜像漏洞。此外合理设置--shm-size8g可避免 DataLoader 因共享内存不足导致的卡死问题这对大 batch size 训练尤为重要。最终你会发现这套组合拳带来的不仅是效率提升更是一种工程文化的转变。当每个人都习惯“先查文档”、“发现问题顺手更新文档”知识就不再是私有资产而成了团队共有资本。即使核心成员离职项目也不会陷入停滞。每一次实验的失败与成功都被转化为可检索的经验条目。对个人而言这意味着你能把精力集中在真正有价值的创新上而不是重复解决已知问题对团队来说这是构建高韧性研发体系的基础而对于开源项目更是降低了社区参与门槛吸引更多贡献者加入。未来随着 MLOps 的演进这种“文档镜像”模式有望进一步与模型注册表、监控告警、A/B 测试平台打通实现从代码提交到文档更新的全自动联动。但在当下从搭建一份结构清晰的 GitHub Wiki 开始已是迈向专业 AI 工程化的坚实一步。